就在最近,谷歌推出了其首个开源人工智能模型,名为 Gemma,有两种规格:Gemma 2B 和 7B。该模型适用于文本生成、摘要、基本推理等英语创造性任务。由于体积小,该模型可以下载并在没有互联网连接的低资源计算机上本地使用。下面是我们在 Windows、macOS 和 Linux 上下载并运行 Google Gemma AI 模型的教程。

下载 Google Gemma 2B 模型

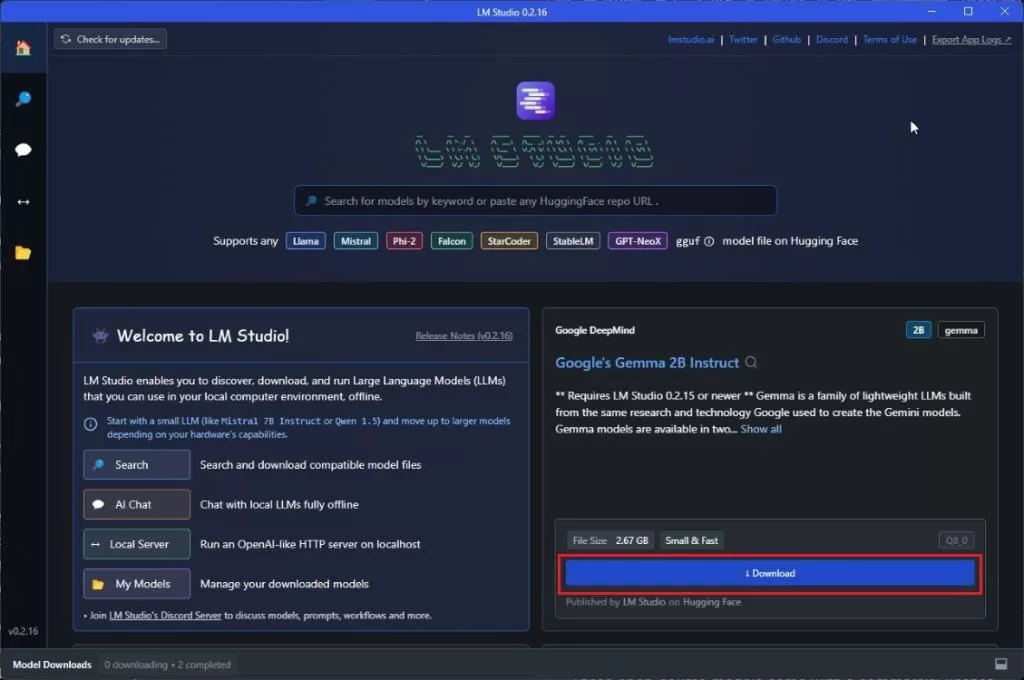

- 在电脑上下载 LM Studio(免费)。然后,启动程序。

- 在主页上,您将找到 “Google 的 Gemma 2B Instruct” 模型。您也可以手动搜索 “Gemma”。现在,打开它。

- 然后,点击 “Download”。这是一个 1.5GB 的文件,因为 Gemma 2B 模型已经过 4 位量化,以压缩模型大小并减少内存使用。如果您的内存超过 8GB,您可以下载 8 位量化模型(2.67GB),它将提供更好的性能。

使用 LM Studio 离线运行 Google Gemma

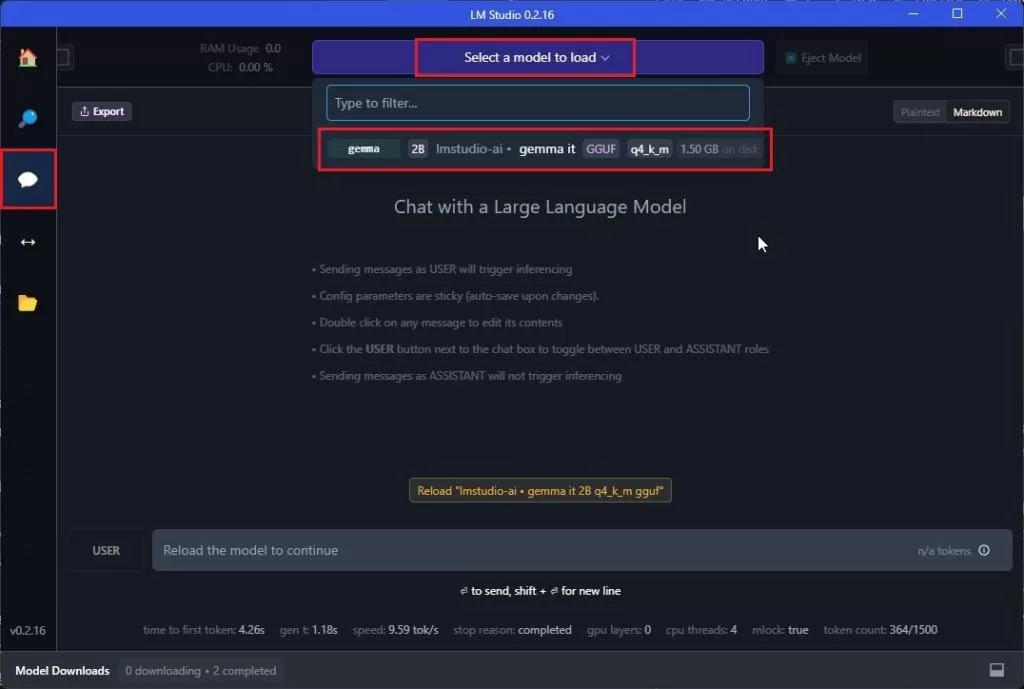

- 在 LM Studio 中,移动到左侧的 “Chat” 窗口。

- 然后,点击 “Select a model to load” 并选择 “gemma”。它将消耗约 1.4GB 内存。

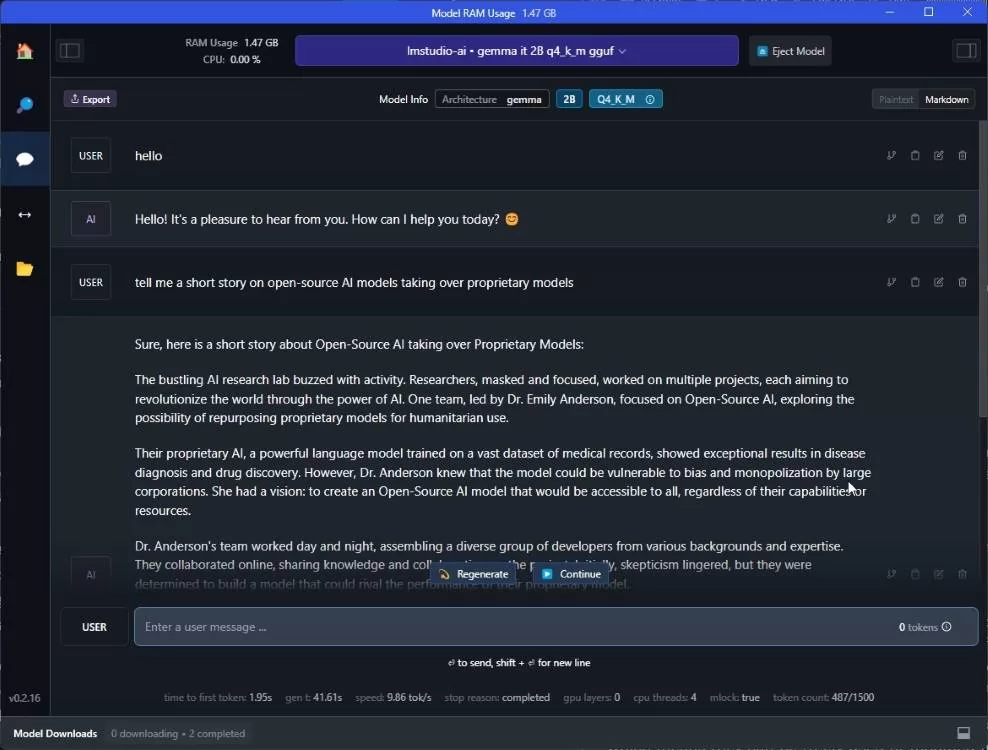

- 现在,请继续提问吧。根据我的经验,小小的 2B Gemma 模型适用于英语语言中的创造性任务。它拒绝回答任何有价值的问题(例如,C 语言比 Rust 语言好吗?)

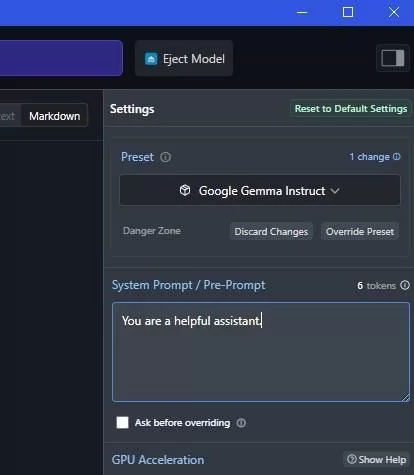

- 您还可以在右侧设置 system prompt,自定义人工智能模型的行为。

这就是如何在 PC、Mac 和 Linux 计算机上下载并运行谷歌 Gemma 模型的方法。虽然我觉得谷歌的开源模型很平淡无奇,但对于那些想在本地运行一个简单的人工智能模型的人来说,它可能会很有用。

总之,这就是我们的全部内容。如果你正在寻找真正的本地人工智能助手,我强烈建议你看看 Open Interpreter。它的工作原理与 ChatGPT 的代码解释器类似,可以在你的电脑上执行实际任务。最后,如果你有任何问题,请在下面的评论区告诉我们。

评论留言